2024년은 대규모 언어 모델(LLM) 분야에서 급격한 변화와 혁신이 이루어진 해였습니다. GPT-4의 한계를 넘어선 다양한 모델들이 등장하며, 가격 경쟁과 멀티모달 지원의 확산이 두드러졌습니다. 이번 글에서는 2024년 LLM 분야에서 배운 주요 변화들을 자세히 분석해보겠습니다.

GPT-4의 한계를 넘어선 모델들의 등장

다양한 조직의 경쟁력 강화

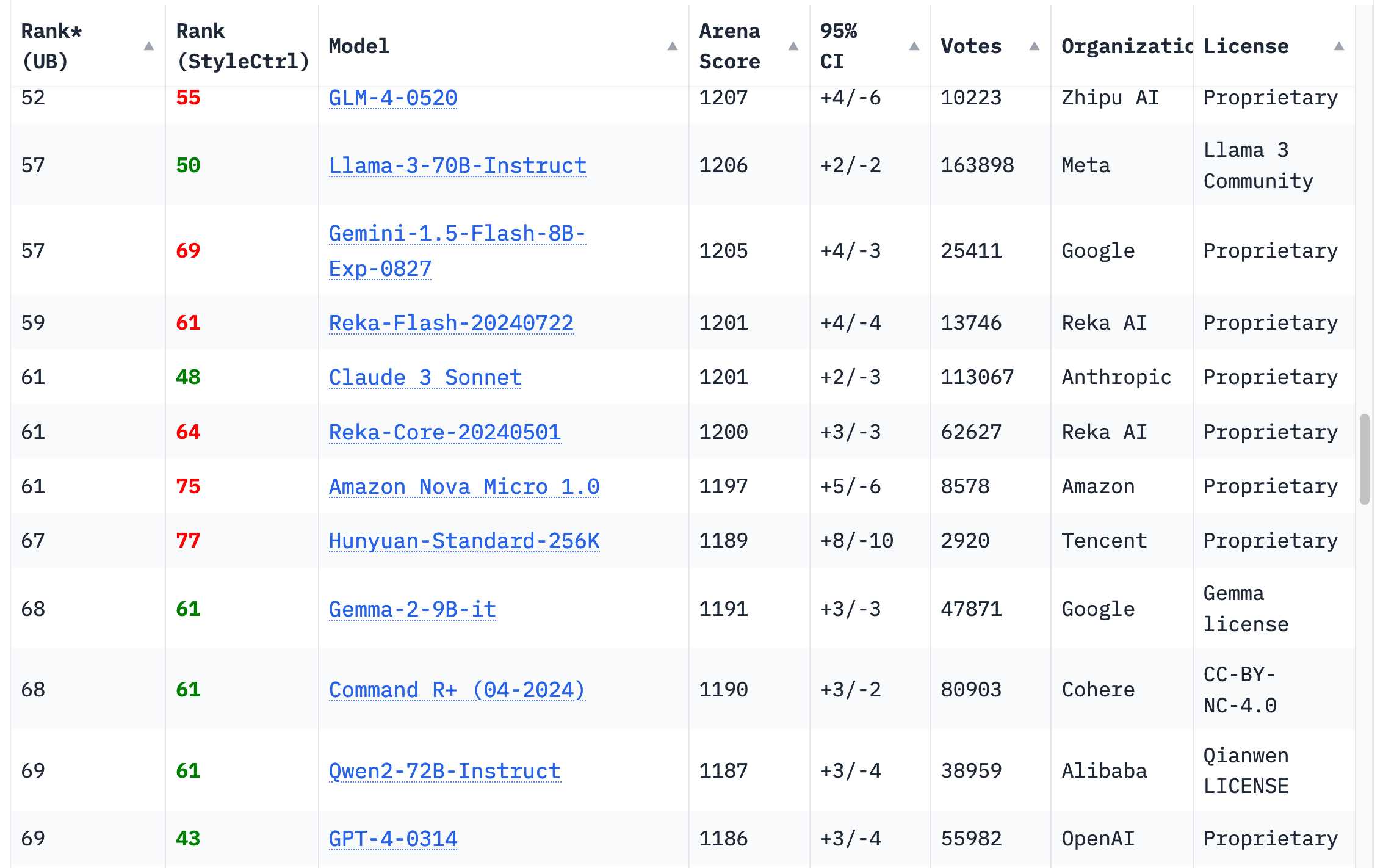

2023년 GPT-4가 최고의 언어 모델로 평가받았으나, 2024년에는 18개 이상의 조직이 이를 능가하는 모델을 발표했습니다. Chatbot Arena 리더보드에는 GPT-4-0314(2023년 3월 출시)를 뛰어넘는 70개의 모델이 등록되어 경쟁이 치열해졌습니다.

주요 모델 및 기술적 발전

- Google Gemini 1.5 Pro: 2024년 2월 출시된 이 모델은 GPT-4 수준의 출력과 함께 100만(후에 200만) 토큰의 입력 컨텍스트 길이를 지원하며, 비디오 입력 기능을 도입했습니다.

- Anthropic Claude 3 시리즈: Claude 3 Opus(3월 출시)와 Claude 3.5 Sonnet(6월 출시)은 높은 성능으로 주목받았습니다.

- Meta Llama 3.3 70B: 2024년 12월 출시된 GPT-4급 모델로, 뛰어난 성능을 자랑합니다.

LLM 가격의 급격한 하락과 그 요인

가격 변화

2023년 말 OpenAI의 주요 모델 가격은 다음과 같았습니다:

- GPT-4: $30/million input tokens

- GPT-4 Turbo: $10/mTok

- GPT-3.5 Turbo: $1/mTok

2024년에는 가격이 크게 하락하였습니다:

- OpenAI o1: $30/mTok

- GPT-4o: $2.50/mTok

- GPT-4o Mini: $0.15/mTok

- Google Gemini 1.5 Flash 8B: $0.0375/mTok

가격 하락 요인

- 경쟁 증가: 다수의 모델 제공자가 시장에 진입하며 가격 경쟁이 심화되었습니다.

- 효율성 향상: 모델 학습과 추론 과정의 최적화로 에너지 소비가 감소하였습니다.

- 에너지 비용 감소: 개별 프롬프트 실행의 에너지 비용 우려가 줄어들었습니다.

멀티모달 지원의 확산: 오디오와 비디오의 등장

멀티모달 모델의 중요성

2024년에는 텍스트 외에도 이미지, 오디오, 비디오 등 다양한 입력을 처리할 수 있는 멀티모달 LLM이 일반화되었습니다. 이는 LLM의 활용 가능성을 크게 확장시켰습니다.

주요 출시

- Google Gemini 1.5 Pro: 이미지, 오디오, 비디오 처리 지원

- OpenAI 오디오 입출력 기능: 10월 추가

- Amazon Nova 이미지 및 비디오 모델: 12월 출시

음성 및 라이브 카메라 모드

- GPT-4o 음성 모드: 2024년 5월 발표되어 오디오 입력과 자연스러운 음성 출력을 지원

- 라이브 비디오 모드: 12월 ChatGPT 음성 모드에 카메라 피드 공유 기능 추가

에이전트 개념과 실현 여부

“에이전트”의 모호한 정의

“에이전트”라는 용어는 여전히 명확한 정의가 부족하며, 사용자마다 다른 의미로 사용되고 있습니다. 주로 두 가지 카테고리로 나뉩니다:

- 사용자를 대신해 작업을 수행하는 모델

- 도구에 접근해 반복 작업을 수행하며 문제를 해결하는 LLM 기반 에이전트

실용성에 대한 회의

LLM의 “쉽게 속는(gullibility)” 성향으로 인해 에이전트의 실용성에 한계가 존재하며, 신뢰할 수 있는 모델 개발이 여전히 중요한 과제로 남아 있습니다.

평가(Evals)의 중요성 부상

평가 도구의 중요성

2024년에는 LLM 기반 시스템에서 좋은 자동 평가(Evals) 작성이 핵심 기술로 부상했습니다. 강력한 평가 도구를 통해 새로운 모델을 빠르게 도입하고, 더 나은 반복 작업과 신뢰할 수 있는 기능 개발이 가능해졌습니다.

Anthropic과 Vercel의 접근법

- Anthropic: 테스트 기반 개발을 통해 시스템 프롬프트를 개선

- Vercel: 프롬프트의 단순성과 평가, 모델, UX의 중요성을 인식하고 방향을 전환

환경적 영향과 개선

에너지 효율성 향상

모델의 효율성이 크게 증가하면서 프롬프트 실행 시 에너지 사용량과 환경적 영향이 감소했습니다. 예를 들어, OpenAI는 GPT-3 시절 대비 프롬프트 비용을 100배 낮추었고, Google Gemini와 Amazon Nova는 저비용 모델을 제공하고 있습니다.

데이터센터 구축 경쟁

주요 기업들이 데이터센터를 구축하며 전력망과 환경에 큰 영향을 미치고 있습니다. 그러나 효율성 향상과 훈련 비용 감소로 인해 이러한 확장이 반드시 필요하지 않을 수도 있다는 논의도 있습니다.

지식 격차와 사용자 교육의 필요성

지식 불균형

LLM 기술의 빠른 변화 속도로 인해 전문가와 일반 사용자 간의 지식 격차가 커지고 있습니다. 사용자 교육이 부족하여 LLM의 효과적인 활용이 어려운 상황입니다.

교육 콘텐츠의 필요성

신뢰할 수 있는 교육 자료 개발이 필요하며, 사용자들이 LLM을 올바르게 이해하고 활용할 수 있도록 돕는 노력이 중요합니다.

미래 전망

모델의 확장 가능성

더 어려운 문제를 처리하기 위해 추론 시점에 추가 계산 자원을 사용하는 모델이 등장하고 있으며, 이는 기존 LLM 아키텍처의 확장을 의미합니다.

무료 접근의 종료와 유료 모델의 부상

OpenAI는 ChatGPT Pro를 출시하며 무료 접근을 종료하고, 월 $200의 구독료를 요구하는 유료 모델을 제공하고 있습니다. 이는 최상의 모델에 대한 무료 접근 시대의 종말을 의미할 수 있습니다.

기술의 지속적인 발전

2025년에는 브라우저 샌드박싱 문제 해결과 다양한 제품에 멀티모달 기능이 기본 탑재될 가능성이 높습니다. 또한, DeepSeek v3와 같은 대규모 모델의 등장으로 모델 효율성과 성능이 더욱 향상될 것으로 예상됩니다.

결론

2024년은 LLM 분야에서 혁신과 경쟁이 치열하게 전개된 해였습니다. GPT-4를 넘어선 다양한 모델의 등장, 가격 하락, 멀티모달 지원의 확산 등이 두드러졌습니다. 그러나 에이전트 개념의 모호성과 환경적 영향, 지식 격차 등의 과제도 여전히 남아 있습니다. 앞으로의 발전을 위해서는 평가 도구의 강화와 사용자 교육이 더욱 중요해질 것입니다.

참고 자료: simon willison, “Things we learned about LLMs in 2024”